Möglichkeiten zum Schutz von Kunstobjekten vor Imitation durch KI

Tobias Rave, Domenik Rofalski

Grundproblem

Die Fortschritte in KI-Bildgenerierungstools erfolgen rasant, wobei innovative Technologien und Algorithmen ständig die Fähigkeiten dieser Systeme erweitern. Diese Entwicklung ermöglicht beeindruckende Ergebnisse in der Generierung von realistischen und kreativen visuellen Inhalten.

Durch die rasante Entwicklung von KI-Bildgenerierungstools ist es mittlerweile jedem möglich, in sekundenschnelle beeindruckende Bilder zu generieren, wodurch die Zugänglichkeit und Anwendungsbreite dieser Technologien kontinuierlich wächst. Die Unterscheidung zwischen menschengemachten und KI-generierten Inhalten wird zunehmend schwieriger, da KI-Modelle ihre Fähigkeiten zur Erzeugung von hochrealistischen und täuschend echten visuellen Elementen stetig verbessern. Dies stellt eine Herausforderung für die Authentifizierung von Bildmaterial dar und wirft Fragen zur Verlässlichkeit von visuellen Informationen auf.

KI nutzt menschengemachte Bilder für Training, erleichtert realistische Bildgenerierung. Unterscheidung wird durch immer überzeugendere Ergebnisse zunehmend herausfordernd. Künstler fürchten "Style Mimicry", dennoch streben sie an, ihre Werke im Internet zu vermarkten, trotz Herausforderungen in der Authentizitätswahrung.

Schutz von Gemälden – Software „Glaze“

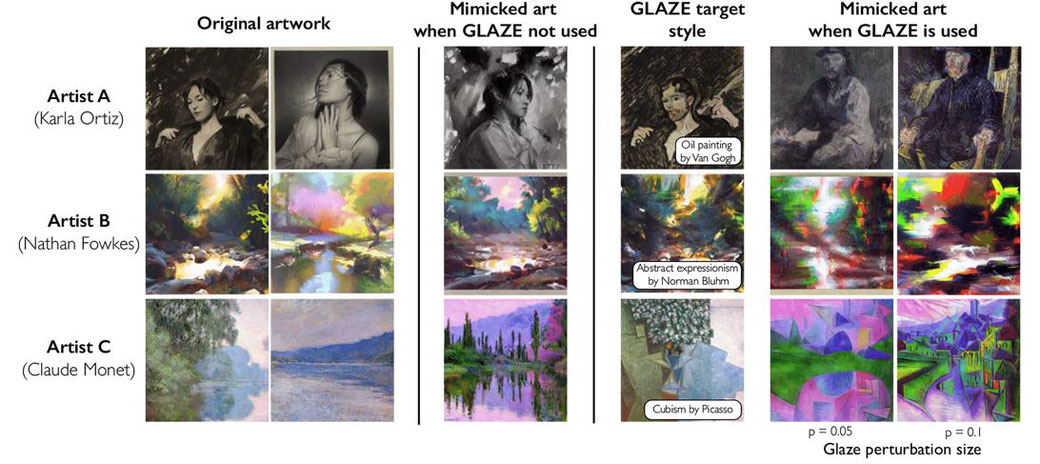

An der University of Chicago wurde ein innovatives System entwickelt, das Kunstwerke vor unerwünschter "Style Mimicry" schützen soll. Das Programm wirkt wie ein Schleier, indem es subtile "Cloaks" oder Störer in das Bild einbaut, die stilbildende Punkte verfälschen. Diese Veränderungen sind für das menschliche Auge kaum sichtbar, jedoch erschweren sie KI-Algorithmen das genaue "Verstehen" des Bildinhalts. Dieser Ansatz bietet Künstlern eine Möglichkeit, ihre kreativen Werke im digitalen Raum zu präsentieren, ohne die Gefahr, dass Algorithmen den individuellen Stil kopieren und nachahmen.

In Zusammenarbeit mit zahlreichen Künstlern und Künstlerinnen wurde dieses Non-Profit-Projekt entwickelt, das kostenfrei zugänglich ist. Erfolgreich an aktuellen Tools getestet, wird es bereits von einigen Künstlern genutzt. Laut dem Leiter, Prof. Ben Zhao, handelt es sich jedoch lediglich um eine Übergangslösung, die vorübergehend Schutz vor "Style Mimicry" bietet. Der Fokus liegt darauf, Künstlern eine kostenfreie und wirksame Methode zur Verfügung zu stellen, um ihre kreativen Werke vor ungewollter Imitation zu bewahren, während weiter nachhaltige Lösungen für den Schutz der künstlerischen Integrität erforscht werden.

Schutz von Fotografie – Leica Kamera

- Typenbezeichnung M11-P

- Kaufpreis ca. 9.000 €

- Integration von CAI (Content Authenticity Initiative) Technologie

- Erste Kamera, die Content Credentials unterstützt

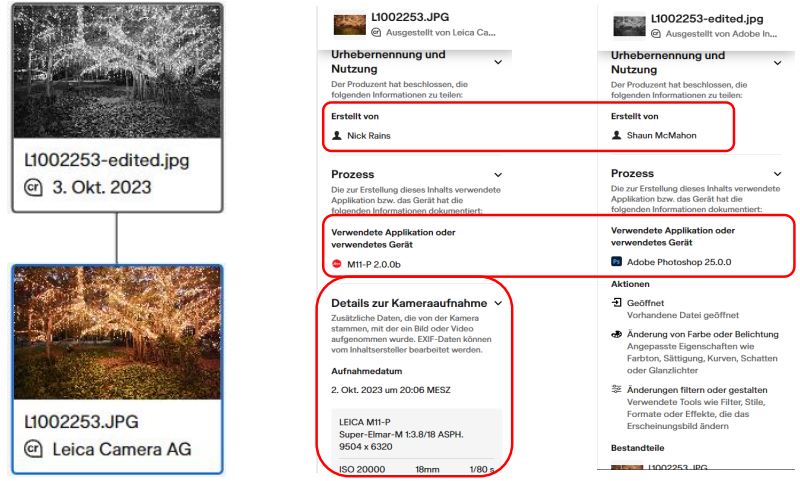

Content Credentials

- Plattform zur Speicherung von Bearbeitungshistorie

- Offenlegung von Bildinformationen:

-

- Name des Erstellers oder Bearbeiters

- Verwendete Kamera- oder Toolinformationen

- Anzeige von Bildmetadaten vom Original (Ersteller, Kameraeinstellungen, Zeitstempel, ...)

- Anzeige von Bildmetadaten von Kopie oder Bearbeitungen (Bearbeiter, Änderungen an der Ursprungsdatei, ...)

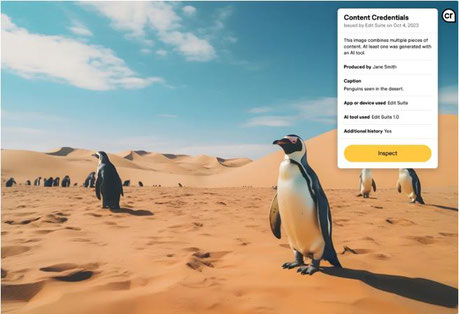

Bilder, die mit Content Credentials markiert sind und auf der Plattform hochgeladen sind, werden mit einem kleinen Icon in der oberen rechten Bildecke markiert.

Mit einem Klick auf das Icon öffnet ein kleiner Reiter, in dem ein paar Basisinformationen direkt angezeigt werden. Zusätzlich besteht die Möglichkeit per Link (Button Inspect) auf die Plattform zu gelangen und dort sich alle Informationen anzeigen zu lassen.

Wasserzeichen unsichtbar

Eine unsichtbare kryptographische Methode dient dazu, KI-generierte Inhalte mit Metadaten im Internet zu markieren. Mithilfe von KI-Check-Tools können diese Markierungen ausgelesen werden. Webseiten sind verpflichtet, den Spezifikationen der Coalition for Content Provenance and Authenticity (C2PA) zu entsprechen, um die Authentizität und Herkunft von Inhalten zu gewährleisten.

Wasserzeichen sichtbar

Ausblick / Dilemma

100 Entwickler engagieren sich in der Verbesserung von KI-Tools, wobei ein einzelner Entwickler Schutzfunktionen gegen KI-Missbrauch entwickelt. Weltweit starten Global Player und Regierungen

Initiativen wie "AI-ACT".

Fazit: Der effektivste Schutz erfordert ein gesteigertes Bewusstsein in der Gesellschaft und eine kritische Hinterfragung von Inhalten,

um den Herausforderungen der KI verantwortungsbewusst zu begegnen.

Bleiben Sie wachsam!

Alle Texte wurden von ChatGPT 3.5 auf Basis der Powerpoint-Präsentation ausformuliert.

Die Inhalte der Texte sind aber aus den angegebenen Quellen entnommen worden.

Download Präsentation

Semesterergebnisse der Seminare »KI & Ethik« und »Neue KI-gestützte Arbeits- und Organisationsformen« der Masterstudiengänge im Fachbereich Wirtschaft der Fachhochschule Kiel